2012 г.

Лабиринты наноэлектроники

Сергей Кузнецов

Обзор февральского, 2011 г. номера журнала Computer (IEEE Computer Society, V. 44, No 2, February 2011).

Авторская редакция.

Также обзор опубликован в журнале «Открытые системы»

Февральский выпуск журнала Computer в этот году посвящен наномасштабным компьютерным архитектурам («Nanoscale Architectures»). Приглашенным редактором тематической подборки (четыре из шести больших статей номера) является Шамик Дас (Shamik Das, MITRE Nanosystems Group). Его вводная статья называется «Переход от микроэлектроники к наноэлектронике» («Transitioning from Microelectronics to Nanoelectronics»).

В течение более 50 лет предсказывалась возможность построения наноэлектронных компьютеров из элементов масштаба атомов или молекул. Почти столько же времени говорят о грядущем упадке полупроводниковой микроэлектронной технологии, лежащей в основе традиционных компьютерных систем. Однако только сейчас наступает время заката кремниевых микроэлектронных устройств, и в компьютерной индустрии требуются новые средства, позволяющие разрабатывать разнообразные новые приложения и поддерживать крупные прибыльные рынки устройств основной памяти и обработки данных.

В предвидении этой новой эпохи исследовательское сообщество пытается решить две ключевые проблемы построения компьютеров без использования полупроводниковой микроэлектроники:

- создание масштабируемой технологии проектирования и производства устройств, способных заменить полупроводниковые схемы;

- разработка архитектур систем, способных обрабатывать информацию с использованием таких устройств.

Многие компьютерные архитекторы считают более приоритетной первую задачу. В конце концов, разработчики привыкли основывать свои архитектуры на правильно построенных абстракциях, позволяющих включать в архитектуру все что угодно – от идеальных коммутаторов до самых неудобных устройств. Однако наноустройства, берущие верх над кремниевыми полупроводниками, способны подорвать даже самые стойкие абстракции. При приближении к нанометровому масштабу меняются взаимосвязи между вычислениями и коммуникациями. Например, при использовании новых наноустройств приходится вводить новые правила для разделения и размещения «кода» и «данных». Возможно, в этом случае нет худа без добра: хотя от проектировщиков систем требуется выходить за пределы архитектур с хранимыми программами, они освобождаются от работы с новыми аппаратными примитивами. На самом деле, посткремниевые наноустройства могут не справиться даже с вычислениями над данными в двоичном представлении.

Поэтому несколько выдающихся архитекторов нанокомпьютеров применяют более необычный подход, затрагивающий и вторую ключевую проблему. Они понимают, что отказ от прежних абстракций и интегрированное решение имеющихся проблем, начиная с уровня устройств, могут привести к разработке систем, в которых, в конечном счете, не будет поддерживаться фон-неймнановская обработка данных. Более того, некоторые архитекторы предпринимают шаги для демонстрации того, как этого можно достичь в близком будущем.

Первая регулярная статья тематической подборки называется «От синапсов к электронным схемам: использование мемристорной памяти для исследования путей создания “электронного мозга”» «From Synapses to Circuitry: Using Memristive Memory to Explore the Electronic Brain» и представлена большой группой авторов из компании Хьюлетт-Пакард и Бостонского университета. Первым автором в списке авторов числится Грег Снайдер (Greg Snider, Hewlett-Packard Laboratories).

Проблема создания электронного мозга пугает исследователей, большей частью потому, что имеется очень слабое понимание о том, как подойти к ее решению. И в самом деле, в силу физических ограничений на соотношение рассеивания мощности и объема (примерно 20 ватт на объем обувной коробки) эта проблема оказывается непосильной для современной технологии.

Одним из аспектов этой проблемы является трансляция синапсов в их электронные эквиваленты. Биологические синапсы размещаются очень плотно – в коре головного мозга на одном квадратном сантиметре имеется примерно 1010 синапсов. Кроме того, они потребляют очень небольшую энергию, имеют сложную структуру, обладают нелинейной динамикой и в некоторых случаях могут сохранять свою память в течение десятилетий. До недавнего времени успешно отобразить эти характеристики в электронные компоненты крупных моделей электронного мозга не удавалось.

Однако в последние несколько лет возросли темпы исследований в области мемристорных устройств, которые могут приблизить разработчиков к архитектуре электронного мозга, адаптивно взаимодействующей с внешним миром в реальном времени. Хотя мемристорные устройства сами по себе не решают проблем мощности и объема, они обладают несколькими привлекательными характеристиками, позволяющими их использовать при реализации синаптической памяти в интеллектуальных машинах:

- их сопротивление меняется нелинейно, и электронные схемы могут изменять его посредством электричества;

- их можно компоновать в коммутаторы для построения плотных устройств памяти;

- многие мемристорные материалы совместимы с процессами комплементарных металло-оксидных полупроводников.

Последняя характеристика является существенной, поскольку позволяет проектировщикам интегрировать плотную мемристорную память с традиционными электронными схемами, располагая их предельно близко. Сокращение расстояния между памятью и электронными схемами позволяет значительно снизить рассеивание мощности при обмене данными между этими компонентами при заметном повышении пропускной способности.

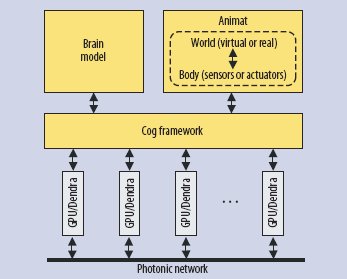

Для раскрутки процесса построения интеллектуальных аппаратных средств исследователи из компании Хьюлетт-Пакард и Бостонского университета совместно разработали аппаратную архитектуру Cog Ex Machina, а также программную инфраструктуру Cog. Совместно они образуют низкостоимостную гибкую цифровую платформу для создания крупных моделей мозга, способных к взаимодействию с модельными или естественными средами в реальном времени.

Хотя эта платформа пока еще не обеспечивает интеллектуального поведения и не обладает характеристиками рассеивания энергии и объема, свойственными биологическим объектам, она предоставляет исследователям возможность быстрого и сравнительно дешевого построения моделей. Модель также легко адаптируется к новым алгоритмам. Программная среда Cog эффективно абстрагирует базовые аппаратные средства, так что исследователей не задевают изменения на аппаратном уровне.

Авторами статьи «Вычисления с применением новых устройств с плавающим затвором» («Computing with Novel Floating-Gate Devices») являются Дэниэль Шинке, Нейл Ди Спигна, Михир Шивешваркар и Пол Фрэнзон (Daniel Schinke, Neil Di Spigna, Mihir Shiveshwarkar, Paul Franzon, North Carolina State University).

Полевые металл-оксидные полупроводниковые транзисторы (Metal Oxide Semiconductor Field Effect Transistor, MOSFET) с использованием программируемых плавающих затворов весьма успешно используются в качестве основы масштабируемой технологии энергонезависимой памяти. Традиционный MOSFET с плавающим затвором – это устройство, в котором в диэлектрик транзистора встроен дополнительный затвор, полностью изолированный от верхнего (управляющего) затвора и канала. Этот так называемый «плавающий затвор» можно использовать как запоминающий узел, который может заряжаться и разряжаться. За счет этого канал снабжается напряжением или защищается от напряжения, которое подается на управляющий затвор, изменяющий пороговое напряжение устройства. Обычно эти устройства проектируются так, чтобы заряд плавающего затвора (и, следовательно, состояние устройства) сохранялся даже при выключении питания системы, что позволяет использовать их в качестве компонентов энергонезависимой памяти.

MOSFET с плавающим затвором перспективны во многих отношениях, но пока они используются только в устройствах энергонезависимой памяти. Одной из причин является то, что подобные устройства оптимизируются, главным образом, в расчете на максимизацию времени хранения (10 лет) в ущерб износостойкости (числу циклов) и требуемому рабочему напряжению. С использованием стеков затворов на основе запрещенной энергетической зоны (band-gap-engineered gate stacks), нескольких металлических плавающих затворов, более тонких окисей и туннелирования в качестве основного механизма передачи зарядов можно добиться более низкого рабочего напряжения, а также, в принципе, повысить износоустойчивость.

Авторы статьи описывают масштабируемое биметаллическое устройство с плавающим затвором, которое может служить основой унифицированной памяти – единого устройства, поддерживающего энергозависимые и энергонезависимые операции. Это устройство потенциально может поддерживать постоянную готовность компьютеров к вычислениям (instant-on computing), помочь решать проблемы эффективного энергопотребления и повысить уровень отказоустойчивости. Рабочее напряжение устройства ниже, чем у большинства устройств с плавающим затвором. Устройство масштабируется по объему до 16-нанометрового узла и потенциально может быть помещено в ячейку 8F2.

Статью «Кристаллы и снежинки: построение компьютеров на основе нанопроводных коммутаторов» («Crystals and Snowflakes: Building Computation from Nanowire Crossbars») написали Андре Дехон и Бенджамин Гойман (André DeHon, Benjamin Gojman, University of Pennsylvania).

В течение 45 лет использования закона Мура в качестве ориентира для долгосрочного планирования полупроводниковая индустрия постоянно сокращала геометрические размеры элементов и повышала емкость микросхем. Масштабированный ликтографический кремний (lithographic silicon) является надежной подложкой, обеспечивая простую и согласованную модель для построения процессоров и заказных микросхем. Постоянное совершенствование производства полупроводниковых устройств приводит к ускорению работы транзисторов; разработчики могут размещать все большее их число в кристалле одного и того же размера, обеспечивая большее количество транзисторов за ту же цену.

В прошлом архитекторы микроустройств могли фокусироваться на обеспечении счет дополнительных транзисторов более высокую производительность и новые функциональные возможности. Однако доступные сегодня и в будущем размеры элементов схем вынуждают архитекторов отходить от старых моделей постоянного масштабирования, произвольной топологии схем, единообразно производимых устройств, надежного и неизменного функционирования устройств и детерминированного изготовления.

Текущие 40-нанометровые размеры элементов СБИС уже сейчас значительно меньше длины световых волн, и они продолжают уменьшаться, что приводит к устройствам с размером, близким к размеру отдельных атомов. В прошлом архитекторы могли использовать тот факт, что размеры элементов СБИС были больше размеров атомов, в то время как литография позволяла усреднить эффекты шероховатости атомов, размещения легирующей примеси и неоднородного травления. Однако теперь они лишены этих возможностей. Потребность в точных и сложных средствах формирования этих наноразмерных элементов уже повысила стоимость литографии, а отсутствие контроля на уровне атомов делает результирующие структуры менее предсказуемыми.

Перспективной альтернативой нисходящей (top-down) литографии является восходящий (bottom-up) синтез материалов и устройств. Вместо построения структуры и определения формы структуры современный химический синтез обеспечивает способы создания структур точных размеров на основе восходящей самосборки. Подобно тому, как у молекул и кристаллов имеются точные фиксированные размеры, можно выращивать и собирать углеродные нанотрубки, атомные слои и кремниевые провода с точными размерами.

Из них можно компоновать регулярные структуры большего размера: сложные кристаллические структуры можно использовать в качестве соединений, запоминающих устройств и вентилей. Размеры этих структур могут составлять всего несколько атомных слоев (3-5 нанометров), и они образуются за счет применения точных самоограничивающихся процессов, а не за счет использования нисходящего формирования.

Однако эти восходящие процессы могут производить только структуры, являющиеся регулярными и очень некачественными по сравнению с сегодняшними интегральными схемами. Они могут производить массивы идентичных параллельных нанопроводов с интегрированными функциями устройств, но не позволяют сгенерировать произвольную топологию на уровне элемента устройства, как это возможно при использовании литографии. В этом смысле, топология и архитектура устройств скорее напоминают аналогичные характеристики кристаллов, а не традиционных схем.

Кроме того, случайные дефекты и отклонения в наномасштабных элементах приводят к тому, что все компоненты становятся разными. В этом смысле, компоненты становятся похожими на снежинки – известные кристаллические структуры, собранные «снизу вверх». Подобные свойства заставляют пересматривать традиционные архитектуры, методы производства и принципы проектирования.

Последняя статья тематической подборки представлена Венджин Рао, Ченгмо Янгом, Рамешем Карри и Алексом Орайлоглы (Wenjing Rao, University of Illinois at Chicago, Chengmo Yang, University of Delaware, Ramesh Karri, New York University, Alex Orailoglu, University of California, San Diego) и называется «На пути к будущим системам с наномасштабными устройствами: преодоление проблемы надежности» («Toward Future Systems with Nanoscale Devices: Overcoming the Reliability Challenge»).

Продолжающееся масштабирование электронных систем от субмикронных комплементарных металло-оксидных полупроводников (КМОП) до нанаэлектронных устройств сулит повышение вычислительной мощности при меньших размерах схем, при меньшем энергопотреблении и при меньших расходах. Однако наша возможность использования этой мощности ограничивается не только имеющимися методами распараллеливания программ, но и (что более важно) неопределенностями внутри самих систем. По мере значительного снижения надежности вычислительных структур и возрастающего соперничества приложений за ресурсы общая среда исполнения программ становится динамической и непредсказуемой. Соответственно, надежность быстро становится основной проблемой КМОП-систем и будущих наномасштабных систем.

Проблема надежности вкупе с фундаментальными изменениями на уровне устройств ставит перед исследователями вопрос, могут ли наномасштабные устройства обеспечить прогнозируемые показатели плотности устройств, их энергопотребления и производительности?

Ряд вопросов порождается наличием нескольких вариантов создания наномасштабных устройств. Поскольку непонятно, какого рода устройства будут в конце концов доминировать, разумно ли пытаться решать проблемы их проектирования на столь ранней стали? Если это имеет смысл, то какими основными предположениями следует руководствоваться, и какие основные проблемы стоит пытаться решать?

Другой набор вопросов касается природы и сущности проблемы надежности. До какой степени можно пытаться использовать существующие подходы при текущем состоянии дел в области надежности? Приводит ли проблем надежности к количественным и качественным последствиям? Требуется ли переосмыслять методологии проектирования?

Третий набор вопросов касается потенциальных предельных ограничений (например, нелинейных фазовых переходов), связанных с проблемой надежности. Могут ли наномасштабные системы обеспечить сулимые преимущества перед КМОП-системами при допустимых расходах?

Для преодоления проблемы надежности необходимо разработать новые подходы, учитывающие преимущества и ограничения наномасштабных устройств и позволяющие интегрировать стратегии повышения надежности на нескольких уровнях иерархии разработки. В статье приводится набросок такого архитектурного подхода с примерами на двух разных архитектурных уровнях: дефектоустойчивость при проектировании логики на основе наномасштабных матричных коммутаторов и отказоустойчивость при использовании ограниченного числа соединений на уровне процессорной архитектуры.

Вне тематической подборки в февральском номере опубликованы две большие статьи. Статья «Устойчивость Captcha с позиций обеспечения безопасности» («Captcha Robustness: A Security Engineering Perspective») написана Джеффом Яном и Ахмадом Салахом эль-Ахмадом (Jeff Yan, Ahmad Salah El Ahmad, Newcastle University, UK).

Captcha, полностью автоматический общедоступный тест Тьюринга для обеспечения возможности отличать людей от компьютеров, называемый также подтверждением общения с человеком (human interaction proof ), – это программа, генерирующая тесты, доступные человеку, но находящиеся за пределами возможностей существующих компьютеров. В этой технологии часто используются трудные нерешенные проблемы искусственного интеллекта, и она используется в качестве стандартного средства защиты коммерческих Web-сайтов от доступа со стороны подозрительных или зловредных программ-роботов. Например, Google, Microsoft и Yahoo внедрили Captcha, чтобы затруднить получение спамерами бесплатных учетных записей для работы с электронной почтой.

В 1996 г. Мони Наор (Moni Naor) впервые предложил использовать автоматические тесты Тьюринга для проверки того, что именно человек, а не робот обращается с запросом к Web-службе. Аналогичную идею в 1998 г. запатентовала компания Alta Vista. Название Captcha было введено в 2000 г. исследовательской группой университета Карнеги-Меллон, руководимой Мануэлем Блюмом (Manuel Blum) и Луисом фон Аном (Luis von Ahn), и программы этого семейства сыграли основную роль в популяризации технологии. На сегодняшний день наиболее распространенные варианты Captcha основаны на том, что пользователей заставляют распознавать искаженные символы, распознавание которых предположительно не под силу имеющимся программам распознавания образов.

Поскольку Captcha, фактически, играет ту же роль, что и простой запросно-ответный протокол (simple challenge-response protocol), соответствующие программы уязвимы к атакам уровня протокола. Например, спамер может нагрузить решением проблем Captcha посетителей порносайтов или перенаправить задачу людям из стран с дешевой рабочей силой. Важен и дизайн системы. Например, при использовании ранних вариантов Captcha хакеры могли просто повторно применять известный им идентификатор сессии, для которой проверка была пройдена ранее.

Авторы статьи исследовали другой аспект безопасности Captcha – устойчивость этих программ по отношению к программам, написанным специально для прохождения тестов Captcha. Было обнаружено, что множество существующих вариантов Captcha, включая схемы, используемые Google, Microsoft и Yahoo, с успехом можно разрушить с использованием новых стратегий атак, опирающихся на наличие фатальных ошибок проектирования каждого из этих вариантов.

В отличие от имеющихся методов повышения устойчивости Captcha, разработанных, прежде всего, в сообществах машинного зрения и распознавания образов, авторы предлагают подход с точки зрения инженерии безопасности, в котором учитываются способы мышления злоумышленников. Хотя основное внимание уделяется вариантам Captcha, основанным на распознавании текстов, полученные результаты применимы и к другим типам Captcha.

Авторами последней крупной статьи номера «Зрелость сервис-ориентированной архитектуры» («Service-Oriented Architecture Maturity») являются Ричард Велке, Руди Хиршхейм и Эндрю Шварц (Richard Welke, Georgia State University, Rudy Hirschheim, Andrew Schwarz, Louisiana State University).

Концепция сервис-ориентированной архитектуры берет начало от предшествующих попыток инкапсулировать функциональные средства обработки данных таким образом, чтобы потребителям не требовалось знать, каким образом и где производилась обработка данных. SOA отличается от предыдущих подходов в нескольких отношениях.

Во-первых, в развитом (и продолжающем развиваться) наборе основанных на XML открытых стандартов определяется все что угодно, от описания сервисов (например, WSDL – Web Services Description Language) до средств коммуникации с сервисом (например, SOAP – Simple Object Access Protocol и REST – Representational State Transfer), правил обнаружения сервиса и подключения (например, UDDI – Universal Description, Discovery, and Integraion) и средств комбинирования сервисов, завершения транзакций и поддержки безопасности. Эти уровни функциональности, в свою очередь, организуются в архитектурный стек. Сервисная шина предприятия (ESB – enterprise service bus) является реализацией этих совокупных функциональных возможностей в виде программной платформы.

Во-вторых, функциональность сервиса может быть очень низкоуровневой или узконаправленной, а может прямо отражать сферу деятельности, терминологию и интересы бизнес-пользователей.

В-третьих, средством коммуникаций с сервисами, независимо от их области действия, является протокол Internet. Это означает, что возможность доступа к любому сервису зависит только от досягаемости, доступности и надежности самой сети Internet. Реальное местоположение сервиса неизвестно пользователям, и, поскольку поиск сервиса в каталоге происходит во время вызова сервиса, это местоположение может изменяться без воздействия на пользователей. Реальная обработка также может изменяться без влияния на пользователей, поскольку у сервиса остается тот же самый интерфейс. Для пользователя обработка заключена в черный ящик, внутренность которого определяется некоторым грубым эквивалентом соглашения об уровне обслуживания. В действительности, не требуется, чтобы сервис оказывался компьютером; существенно только то, чтобы обмен информацией с сервисом производился с использованием стандартных, основанных на XML сообщений с использованием некоторого протокола Internet, такого как HTML или SMTP. Эти протоколы могут использоваться и в публичных, и в частных сетях.

Возможности SOA можно оценивать с нескольких точек зрения. С точки зрения IT SOA обеспечивает новый способ решения давнишних проблем повторного использования, сопровождения и интеграции корпоративных приложений. Для бизнес-менеджеров SOA обеспечивает средства нахождения сервисов, которые могут наилучшим образом обслужить их внутренних и внешних клиентов. Для руководителей предприятий SOA обеспечивает возможность изменить структуру организации для совершенствования управления потоками создания ценностей.

Хотя консультанты, производители и некоторые IT-первопроходцы пропагандируют SOA как технологию нового поколения, в профессиональных публикациях отмечается неспособность SOA к достижению организационных целей и обеспечению возврата инвестиций и даже провозглашается, что SOA мертва. Однако авторы статьи полагают, что эти неудачи объясняются неспособностью существующих инфраструктур SOA учитывать различия в мотивации использования SOA у IT-администраторов, бизнес-менеджеров и владельцев предприятий. Для устранения этой бреши предлагается модель зрелости SOA, в которой используется основная терминология CMMI (apability Maturity Model Integration), но отражается продолжающийся переход от мотиваций под влиянием IT, к мотивациям, основанным на потребностях предприятий.

Удачи всем вам, до новой встречи, Сергей Кузнецов